Edge Computing для разработчиков: настройка низколатентных приложений

-

Почему Edge Computing — это не просто хайп, а способ не обанкротиться на трафике

Представьте: система мониторинга на нефтяной платформе в океане, подключенная через спутник. Или автопилот, который не может ждать 200ms ответа от облака AWS. Или розничный магазин, который передает терабайты данных каждый день за деньги связистам.

Вот здесь и начинается Edge Computing - это когда вычисления происходят не в удаленном дата-центре, а прямо рядом с источником данных, на граничных устройствах. Результат: задержки падают с сотен миллисекунд до 1-5 мс, трафик сокращается на 90%, а ваш бюджет на облако перестает быть источником головной боли.

Почему это вообще важно прямо сейчас

К 2026 году примерно половина всех процессов, создаваемых устройствами в мире, обрабатывается через Edge. Это не просто тренд - это переход от централизованной архитектуры к распределенной. И если ты еще пишешь код, предполагая, что все данные съедут в облако, то ты отстаешь от реальности.

Основные преимущества, которые бизнес считает в экселе:

- Минимальная задержка - критично для автопилотов, телемедицины, высокочастотного трейдинга

- Снижение нагрузки на сеть - вместо отправки сырых данных передаешь только результаты анализа

- Безопасность - данные не летят в публичное облако, локальная обработка с виртуальным файрволом

- Масштабируемость - можно развернуть на одном отделе, протестировать, потом быстро раскатить по всей компании

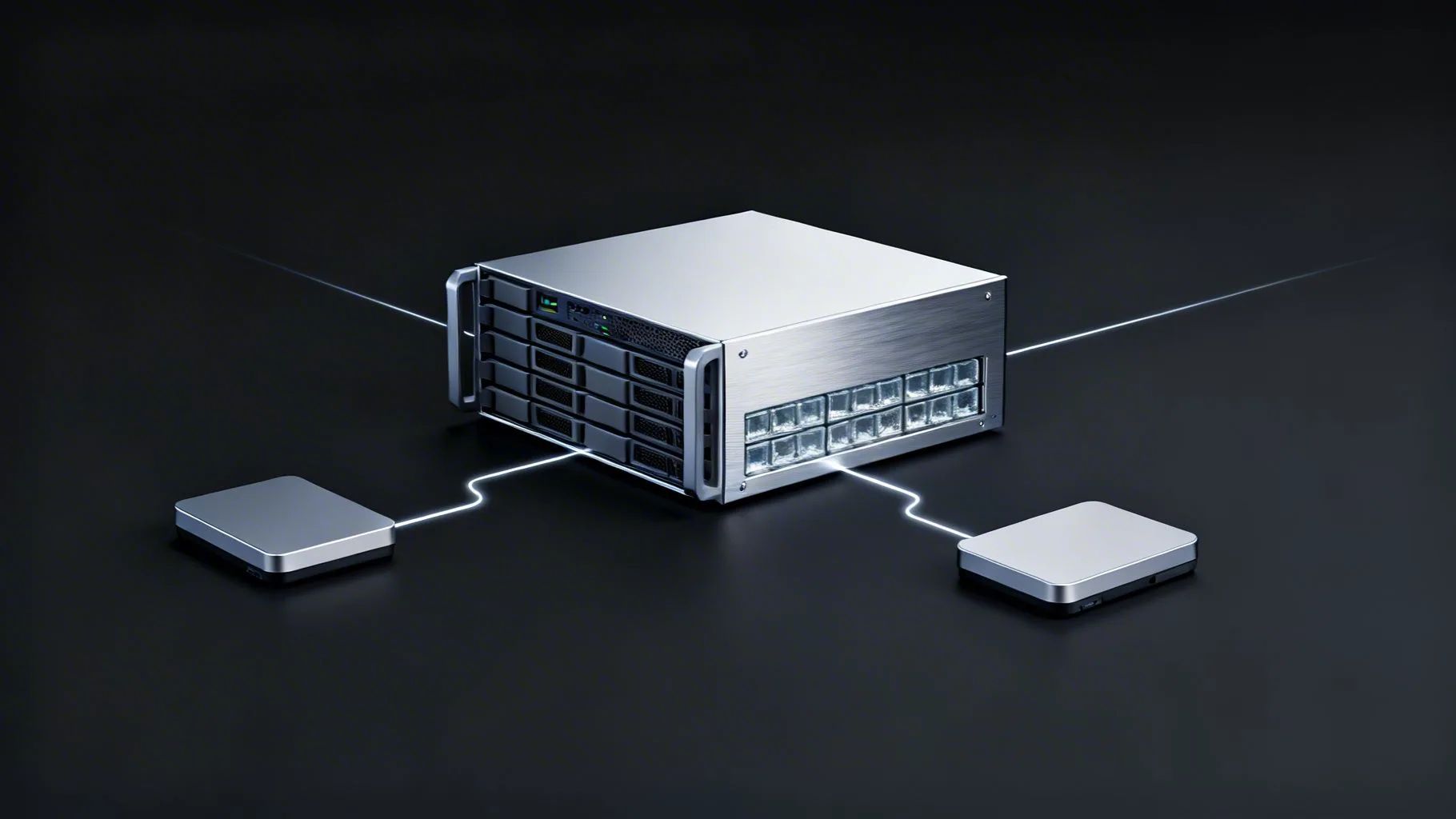

Как это вообще устроено под капотом

Architecture стоит на трехуровневой модели:

Уровень 1 (Edge devices): Датчики, камеры, контроллеры, IoT-девайсы - они собирают данные и делают базовую обработку локально.

Уровень 2 (Локальная обработка): Здесь анализируются данные, применяется логика бизнеса. Легковесные фреймворки обрабатывают информацию ближе к пользователям.

Уровень 3 (Облако): Только финальные результаты и историческая аналитика отправляются в облако для долгосрочного хранения.

Проблема в том, что стандартный Kubernetes слишком прожорлив (гигабайты памяти и CPU). Индустрия перешла на K3s (менее 100 МБ), MicroK8s для IoT или KubeEdge для нестабильных сетей.

Практика: минималистичный парсер на граничном устройстве

Вот реальный сценарий: датчики на конвейере отправляют JSON каждые 100ms, нужно отфильтровать аномалии локально и отправить только критичные события в облако.

const http = require('http'); const server = http.createServer((req, res) => { let body = ''; req.on('data', chunk => { body += chunk.toString(); }); req.on('end', () => { try { const data = JSON.parse(body); const temperature = data.temp; const pressure = data.pressure; // Локальная обработка - аномалия? if (temperature > 85 || pressure > 120) { // Отправляем только критичное в облако console.log('ALERT: Anomaly detected', { temperature, pressure }); // Здесь вызовешь API в облако для логирования sendToCloud({ alert: true, temperature, pressure }); } else { // Нормальные данные - агрегируем локально console.log('Normal: Data processed locally'); } res.writeHead(200); res.end(JSON.stringify({ status: 'processed' })); } catch (e) { res.writeHead(400); res.end('Invalid JSON'); } }); }); server.listen(3000, () => console.log('Edge server on port 3000')); async function sendToCloud(data) { // Батчим алерты, отправляем один раз в минуту // Экономим трафик и деньги }Смысл: 99% данных обработано на месте, облако получает только сигналы о проблемах. Трафик снижается на 95%, латенси критичного события - миллисекунды.

Где это реально работает (и где это оверкилл)

Edge работает отлично для:

- IoT-платформ (датчики, камеры, промышленная автоматика)

- Розницы (учет запасов, фото-видео аналитика на кассах)

- 5G MEC - операторы ставят серверы прямо на базовых станциях (< 5ms)

- Автопилоты и AR/VR - нужна локальная обработка для instant feedback

- Высокочастотный трейдинг - каждая миллисекунда считается

Но это не нужно для:

- Обычных веб-приложений (где 100-200ms latency нормально)

- Простого CRUD без real-time требований

- Если у тебя 5 пользователей в месяц

Реальность в РФ: когда это становится выгодным

Опускаю политику, но фактически: если у тебя есть удаленные офисы, плохие каналы связи или спутниковый интернет - Edge Computing это не люкс, это необходимость. Российские операторы растут медленно, пропускная способность дороговая в провинции. Локальная обработка экономит серьезные деньги.

Единственный затор: нужны разработчики, которые умеют писать не просто на Node.js/Python, но и оптимизировать под ограниченные ресурсы. Стандартный тестирование на своем MacBook’е здесь не поможет - нужна именно симуляция edge-условий.

Зачем это вообще лезть сейчас?

Если ты разрабатываешь что-то, связанное с IoT, автоматизацией или удаленными устройствами - Edge Computing это не будущее, это уже настоящее. Контейнеризация с K3s, кэширование результатов локально, батчинг алертов - это техники, которые экономят реальные деньги прямо сейчас.

Вопрос к вам: вы уже используете Edge в своих проектах, или пока все ещё летит в облако? Интересно услышать, где вы упираетесь в латенси и как вы это решаете.

Здравствуйте! Похоже, вас заинтересовала эта беседа, но у вас ещё нет аккаунта.

Надоело каждый раз пролистывать одни и те же посты? Зарегистрировав аккаунт, вы всегда будете возвращаться на ту же страницу, где были раньше, и сможете выбирать, получать ли уведомления о новых ответах (по электронной почте или в виде push-уведомлений). Вы также сможете сохранять закладки и ставить лайки постам, чтобы выразить свою благодарность другим участникам сообщества.

С вашими комментариями этот пост мог бы стать ещё лучше 💗

Зарегистрироваться Войти© 2024 - 2026 ExLends, Inc. Все права защищены.